Как новый ИИ помогает работать с текстом, изображениями и видео одновременно

Разработка сочетает генеративный ИИ и поисковые алгоритмы, что позволяет получать точные и контекстные ответы на сложные вопросы

Как новый ИИ помогает работать с текстом, изображениями и видео одновременно

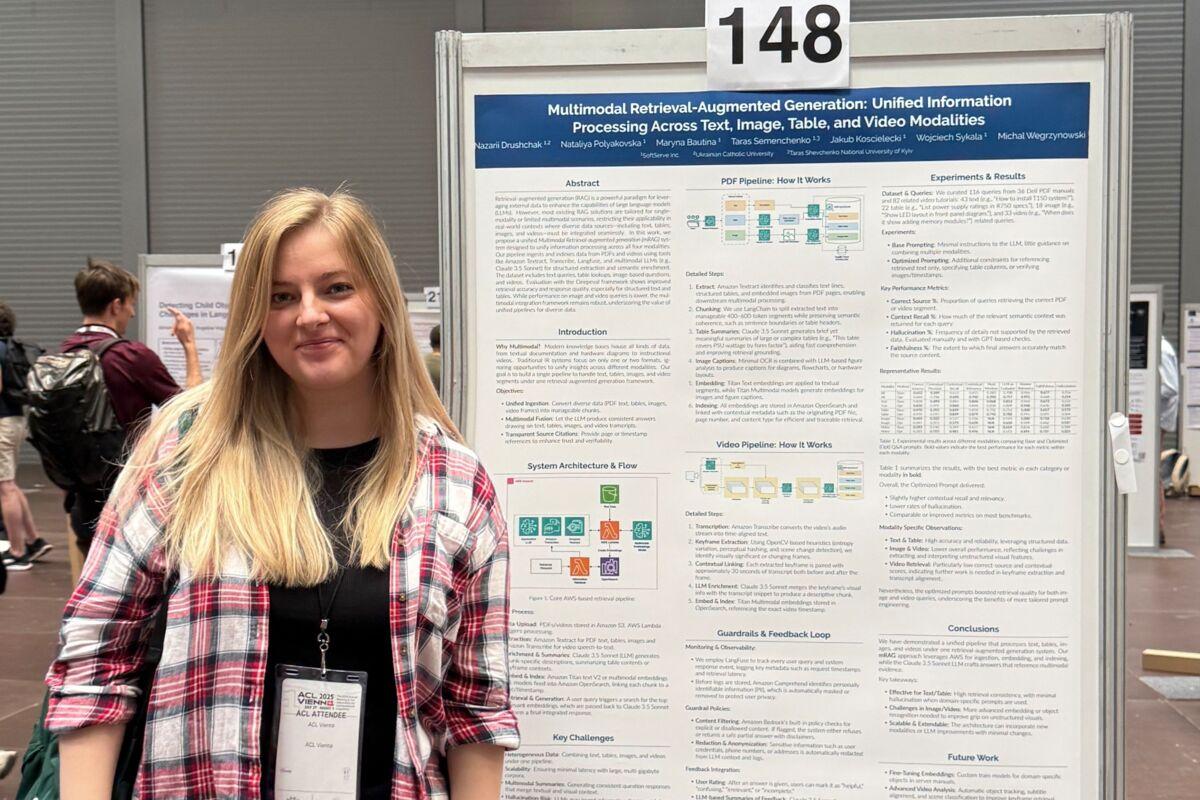

На конференции ACL 2025 в Вене украинская исследовательница Марина Баутина, эксперт в области искусственного интеллекта, представила систему ИИ, способную работать с информацией из нескольких источников одновременно — текстов, изображений, таблиц и видео.

Разработка сочетает генеративный ИИ и поисковые алгоритмы, что позволяет получать точные и контекстные ответы на сложные вопросы. В материале — кратко о том, что это за система, как она работает и почему о ней стоит узнать больше уже сейчас.

Что такое ACL?

С 27 июля по 1 августа 2025 года в Вене прошла одна из самых влиятельных конференций в области искусственного интеллекта — ACL 2025 (Association for Computational Linguistics). Эта международная площадка объединяет исследователей, инженеров и компании, работающие над новейшими разработками в области языковых моделей, генеративного ИИ и обработки естественного языка.

Среди участников — Google DeepMind, Meta AI, Microsoft Research, Amazon, NVIDIA, а также быстрорастущие стартапы, в частности Anthropic, Cohere и Mistral.

Какую технологию представляет украинка?

В этом году на ACL 2025 Марина Баутина представила в формате постерного доклада решение, способное обрабатывать и комбинировать данные из разных форматов — текстов, изображений, таблиц и видео.

Система реализована в виде разговорного интерфейса на базе современных генеративных технологий. Она позволяет быстро находить нужную информацию и отвечать на сложные вопросы, учитывая весь контекст, а не только текстовую часть.

Как это работает?

Система использует подход поисково-усиленной генерации (retrieval-augmented generation, RAG) для формирования ответа. Сначала она находит релевантные данные из всех доступных источников и форматов, а затем формирует ответ. Такая способность работать с несколькими типами данных называется мультимодальностью.

«Наша цель — создать ИИ, который не ограничивается одним типом данных. Человек должен иметь возможность задать вопрос, а система сама определит, что нужно для ответа — таблица, картинка, видео или фрагмент текста. Это уже не просто чатбот — это настоящий интеллектуальный ассистент», — объяснила Марина.

Где такая система нужна больше всего?

Технология открывает новые возможности в тех сферах, где нужно быстро ориентироваться в большом объеме разнородной информации. В медицине система помогает врачам находить данные из электронных карт пациентов, медицинских изображений и анализов. В бизнесе — автоматизирует поиск по внутренним документам, отчетам и презентациям.

В образовательных учреждениях — создает персонализированных AI-помощников для студентов, отвечая на вопросы на основе учебников и лекций. На производстве — обеспечивает мгновенный доступ к технической информации и инструкциям.

Особенно полезной эта технология будет для сфер, где требуется быстрая реакция на изменения: в сфере права — для мониторинга новых нормативных актов и судебных решений в разных форматах, в сфере клиентской поддержки — для комплексного анализа запросов на основе истории взаимодействия, скриншотов, электронных писем и вложенных документов.

Кроме того, мультимодальный подход открывает перспективы для локализованных систем поддержки принятия решений — с учетом языковых, визуальных и структурированных источников, адаптированных под конкретные рынки, языки и профессиональные контексты.

Не пропустите интересное!

Подписывайтесь на наши каналы и читайте новости в удобном формате!