Як новий ШІ допомагає працювати з текстом, зображеннями та відео одночасно

Розробка поєднує генеративний ШІ та пошукові алгоритми, що дозволяє отримувати точні й контекстні відповіді на складні запитання

Як новий ШІ допомагає працювати з текстом, зображеннями та відео одночасно

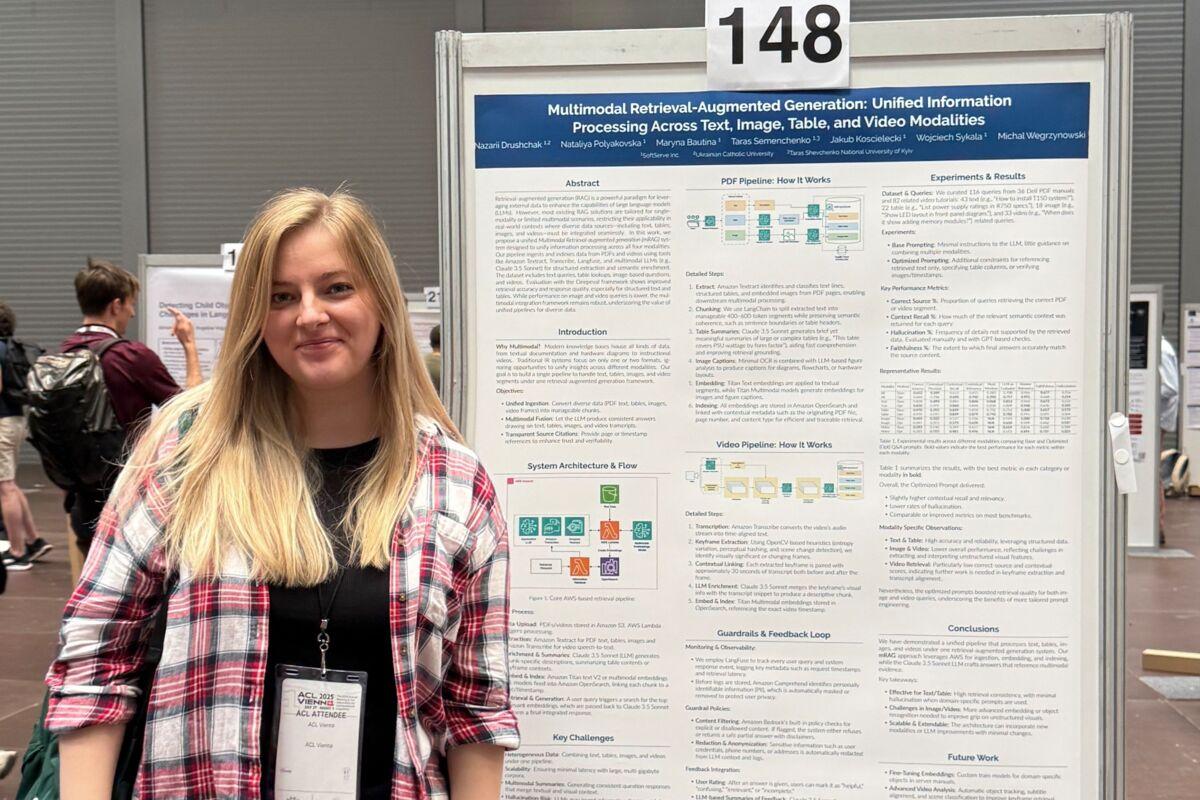

На конференції ACL 2025 у Відні українська дослідниця Марина Баутіна, експертка у сфері штучного інтелекту, презентувала систему штучного інтелекту, здатну працювати з інформацією з кількох джерел одночасно — текстів, зображень, таблиць і відео.

Розробка поєднує генеративний ШІ та пошукові алгоритми, що дозволяє отримувати точні й контекстні відповіді на складні запитання. У матеріалі — коротко про те, що це за система, як вона працює та чому про неї варто дізнатися більше вже зараз.

Що таке ACL?

З 27 липня по 1 серпня 2025 року у Відні відбулася одна з найвпливовіших конференцій у галузі штучного інтелекту — ACL 2025 (Association for Computational Linguistics). Цей міжнародний майданчик об’єднує дослідників, інженерів та компанії, які працюють над найновішими розробками в галузі мовних моделей, генеративного ШІ та обробки природної мови.

Серед учасників — Google DeepMind, Meta AI, Microsoft Research, Amazon, NVIDIA, а також стартапи, що швидко зростають, зокрема Anthropic, Cohere та Mistral.

Яку технологію представляє українка?

Цього року на ACL 2025 Марина Баутіна презентувала у форматі постерної доповіді рішення, здатне обробляти й комбінувати дані з різних форматів — текстів, зображень, таблиць і відео.

Система реалізована у вигляді розмовного інтерфейсу на базі сучасних генеративних технологій. Вона дозволяє швидко знаходити потрібну інформацію та відповідати на складні запитання, враховуючи увесь контекст, а не лише текстову частину.

Як це працює?

Система використовує підхід пошуково-підсиленого генерування (retrieval-augmented generation, RAG) для формування відповіді. Спершу вона знаходить релевантні дані з усіх доступних джерел і форматів даних, а вже потім формує відповідь. Така здатність працювати з кількома типами даних називається мультимодальністю.

“Наша мета — створити ШІ, який не обмежується одним типом даних. Людина має мати змогу поставити запитання, і система сама визначить, що потрібно для відповіді — таблиця, картинка, відео чи уривок тексту. Це вже не просто chatbot — це справжній інтелектуальний асистент,” — пояснила Марина.

Де така система потрібна найбільше?

Технологія відкриває нові можливості в тих сферах, де потрібно швидко орієнтуватися у великому обсязі різнорідної інформації. У медицині система допомагає лікарям знаходити дані з електронних карток пацієнтів, медичних зображень та аналізів. У бізнесі — автоматизує пошук по внутрішніх документах, звітах і презентаціях.

В освітніх закладах - створювати персоналізованих AI-помічників для студентів, відповідаючи на запитання на основі підручників і лекцій. На виробництві — забезпечує миттєвий доступ до технічної інформації та інструкцій.

Особливо корисною ця технологія буде для сфер, де потрібна швидка реакція на зміни: у сфері права — для моніторингу нових нормативних актів і судових рішень у різних форматах; у сфері клієнтської підтримки — для комплексного аналізу запитів на основі історії взаємодії, скріншотів, електронних листів та вкладених документів.

Крім того, мультимодальний підхід відкриває перспективи для локалізованих систем підтримки прийняття рішень — з урахуванням мовних, візуальних і структурованих джерел, адаптованих під конкретні ринки, мови й професійні контексти.

Не пропустіть цікавинки!

Підписуйтесь на наші канали та читайте новини у зручному форматі!